Author :(Microsoft Research) Jiaqi Zhang, Joel Jennings, Cheng Zhang, Chao Ma

Paper Link: https://arxiv.org/abs/2310.00809

Author :(Microsoft Research) Jiaqi Zhang, Joel Jennings, Cheng Zhang, Chao Ma

Paper Link: https://arxiv.org/abs/2310.00809

Author :(Google DeepMind) Andrew Kyle Lampinen, Stephanie C Y Chan, Ishita Dasgupta, Andrew J Nam, Jane X Wang

Paper Link: https://arxiv.org/abs/2305.16183

Talk1: https://www.youtube.com/watch?v=XkPv9bk4O3I (http://lxmls.it.pt/2023/slides/andrew.pdf)

Talk2: https://www.youtube.com/watch?v=3Go7yF5n62c

Author :(Microsoft) Cheng Zhang, Stefan Bauer, Paul Bennett, Jiangfeng Gao, Wenbo Gong, Agrin Hilmkil, Joel Jennings, Chao Ma, Tom Minka, Nick Pawlowski, James Vaughan

Paper Link: https://arxiv.org/abs/2304.05524

Author : Matej Zečević, Moritz Willig, Devendra Singh Dhami, Kristian Kersting

Paper Link: https://arxiv.org/abs/2301.12292

Code: https://github.com/moritzwillig/causalparrots

TMLR presentation: https://www.youtube.com/watch?v=vbwrhbuvedE

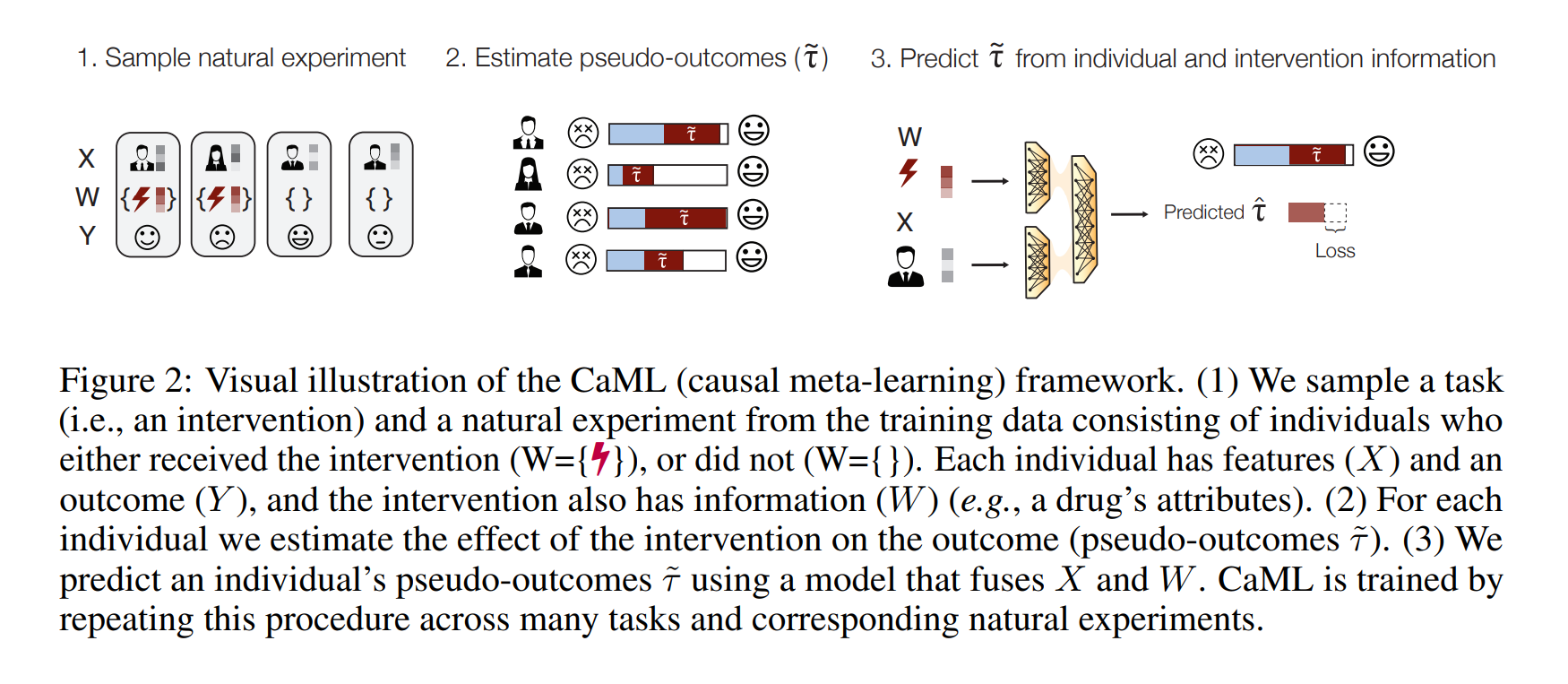

Author : Hamed Nilforoshan, Michael Moor, Yusuf Roohani, Yining Chen, Anja Šurina, Michihiro Yasunaga, Sara Oblak, Jure Leskovec

Paper Link: https://arxiv.org/abs/2301.12292

Author : Ahmed Alaa, Zaid Ahmad, Mark van der Laan

Paper Link: https://arxiv.org/abs/2308.14895

Github: https://github.com/AlaaLab/conformal-metalearners

GitHub - AlaaLab/conformal-metalearners: Codebase for the paper "Conformal Meta-learners for Predictive Inference of Individual

Codebase for the paper "Conformal Meta-learners for Predictive Inference of Individual Treatment Effects" - GitHub - AlaaLab/conformal-metalearners: Codebase for the paper "Conformal...

github.com

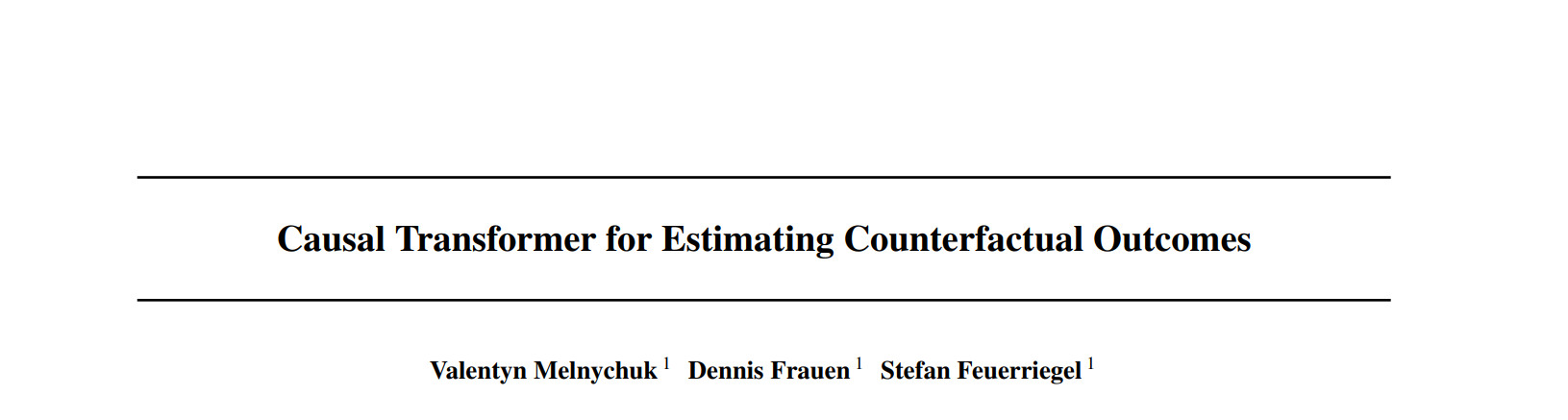

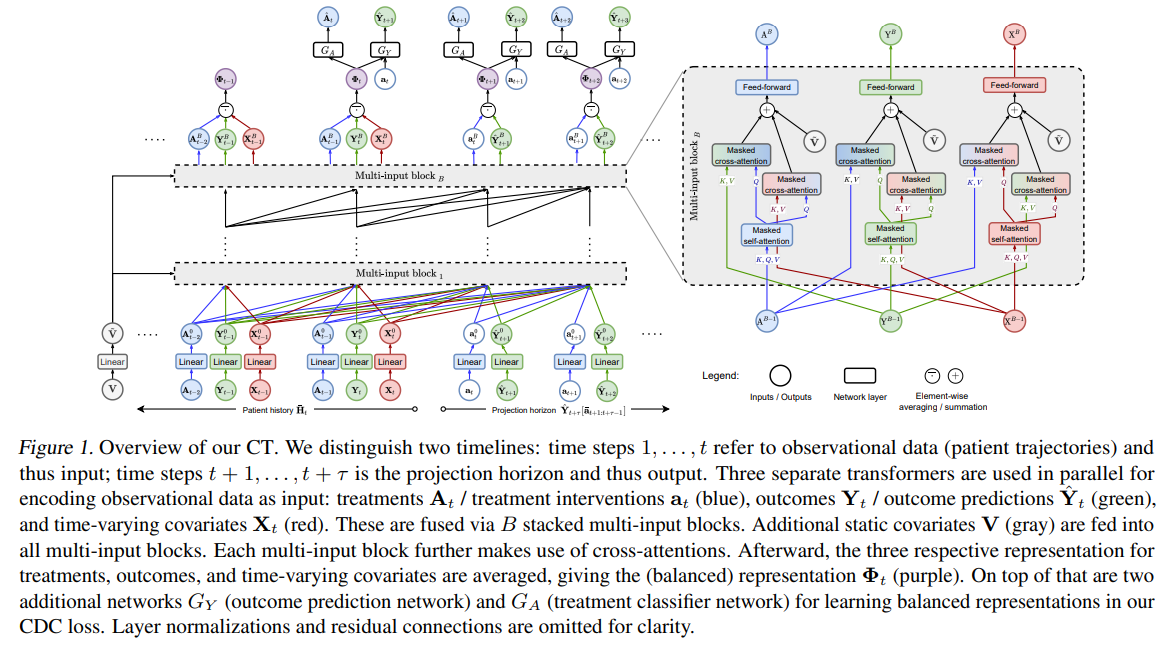

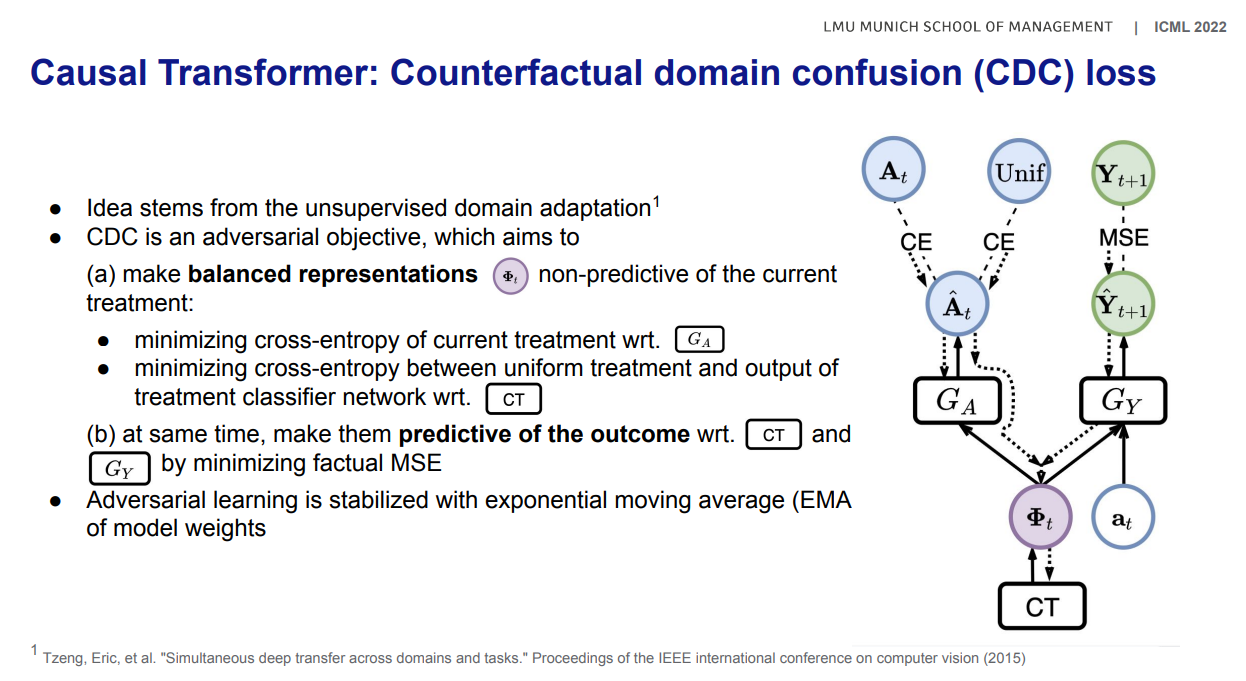

Author: Valentyn Melnychuk, Dennis Frauen, Stefan Feuerriegel

Paper Link: https://arxiv.org/abs/2204.07258

Code: https://github.com/Valentyn1997/CausalTransformer

ICML slide: https://icml.cc/media/icml-2022/Slides/17693.pdf

ICML presentation: https://slideslive.ch/38983812/causal-transformer-for-estimating-counterfactual-outcomes?ref=recommended

[Domain confusion loss]

[Gradient reversal]

Author : Pedro A. Ortega, Markus Kunesch, Grégoire Delétang, Tim Genewein, Jordi Grau Moya, Joel Veness, Jonas Buchli, Jonas Degrave, Bilal Piot, Julien Perolat, Tom Everitt, Corentin Tallec, Emilio Parisotto, Tom Erez, Yutian Chen, Scott Reed, Marcus Hutter, Nando de Freitas, Shane Legg

Paper Link : https://arxiv.org/abs/2110.10819

Author: Ioana Bica, Ahmed M Alaa, Mihaela van der Schaar

Paper Link: https://arxiv.org/abs/1902.00450

Talk in ICML2020: https://icml.cc/virtual/2020/poster/6131

Talk in van der Schaar Lab's Yutube Channel: https://www.youtube.com/watch?v=TNPce1zd6rE

Code: https://github.com/ioanabica/Time-Series-Deconfounder

0. Abstract

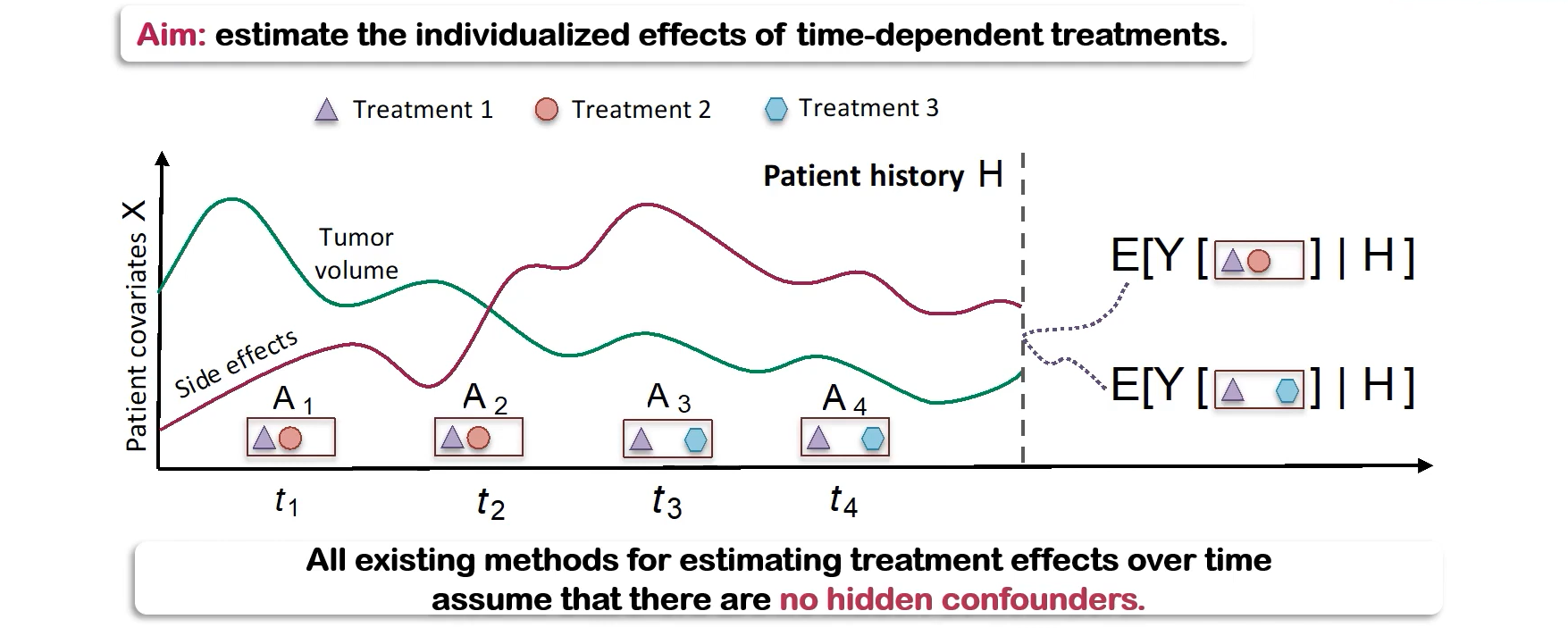

1. Introduction

2. Related Work

3. Problem Formulation

$\mathbb{E}[\mathbf{Y}(\overline{a}_{\geq{t}}){\vert}\overline{\mathbf{A}}_{t-1},\overline{\mathbf{X}}_t]$

$\mathbb{E}[\mathbf{Y}(\overline{a}_{\geq{t}}){\vert}\overline{\mathbf{A}}_{t-1},\overline{\mathbf{X}}_t]=\mathbb{E}[\mathbf{Y}{\vert}\overline{a}_{\geq{t}},\overline{\mathbf{A}}_{t-1},\overline{\mathbf{X}}_t]$

Assumption 1. Consistency

Assumption 2. Positivity (Overlap)

Assumption 3. Sequencial strong ignorability (no hidden confounders)

$\mathbf{Y}(\overline{a}_{\geq{t}}){\perp\!\!\!\!\perp}\mathbf{A}_t\vert\overline{\mathbf{A}}_{t-1},\overline{\mathbf{X}}_{t}$

$\mathbb{E}[\mathbf{Y}(\overline{a}_{\geq{t}}){\vert}\overline{\mathbf{A}}_{t-1},\overline{\mathbf{X}}_t]\neq \mathbb{E}[\mathbf{Y}{\vert}\overline{a}_{\geq{t}},\overline{\mathbf{A}}_{t-1},\overline{\mathbf{X}}_t]$

4. Time Serise Deconfounder

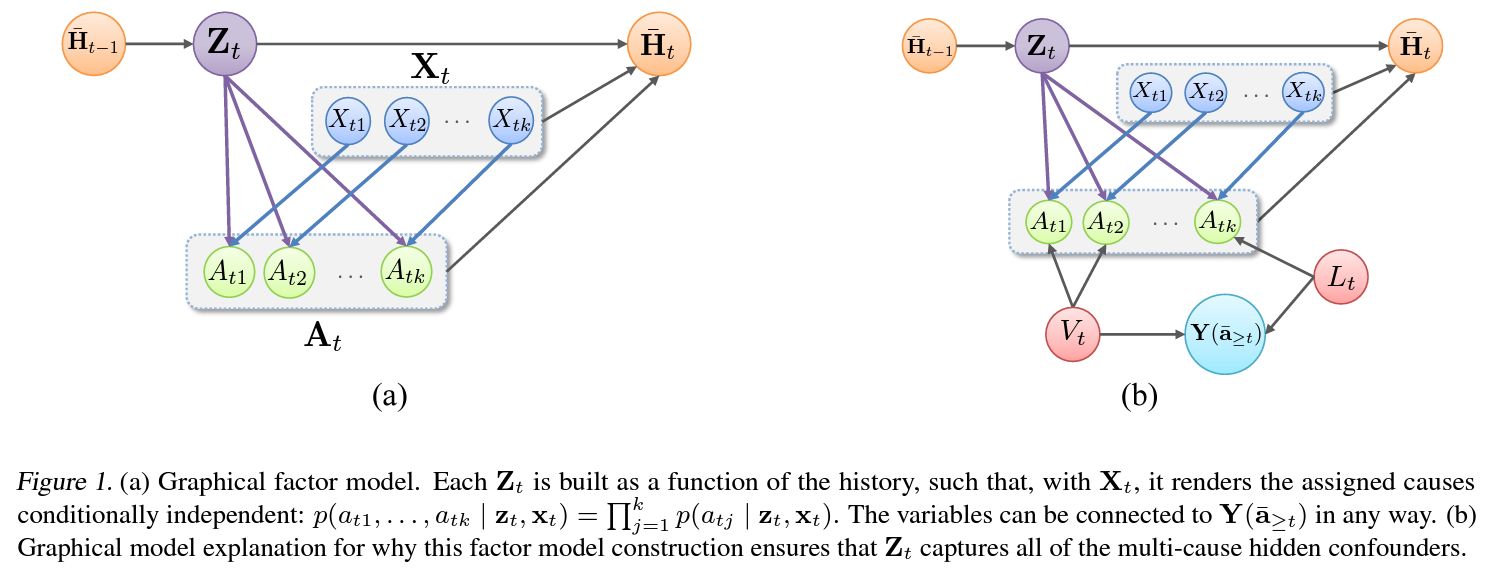

4.1. Factor Model

$\mathbf{z}_t=g(\overline{\mathbf{h}}_{t-1})$

,where $\overline{\mathbf{h}}_{t-1}=(\overline{\mathbf{a}}_{t-1},\overline{\mathbf{x}}_{t-1},\overline{\mathbf{z}}_{t-1})$

Assumption 3. Sequential single strong ignorability (no hidden single cause confounders)

$\mathbf{Y}(\overline{a}_{\geq{t}}){\perp\!\!\!\!\perp}{A}_{tj}\vert\mathbf{X}_{t},\overline{\mathbf{H}}_{t-1}$

$\frac{1}{M}\sum_{i=1}^{M}\mathbf{1}(T(a_{t,rep}^{i})<T(a_{t,val}))$

,where $T(a_t)=\mathbb{E}_z[\mathrm{log}\,p(a_t{\vert}Z_t,X_t)]$ is test statistic and $\mathbf{1(\cdot)}$ is indicator function

4.2. Outcome Model

$\mathbb{E}[\mathbf{Y}(\overline{a}_{\geq{t}}){\vert}\overline{\mathbf{A}}_{t-1},\overline{\mathbf{X}}_t]=\mathbb{E}[\mathbf{Y}{\vert}\overline{a}_{\geq{t}},\overline{\mathbf{A}}_{t-1},\overline{\mathbf{X}}_t]$

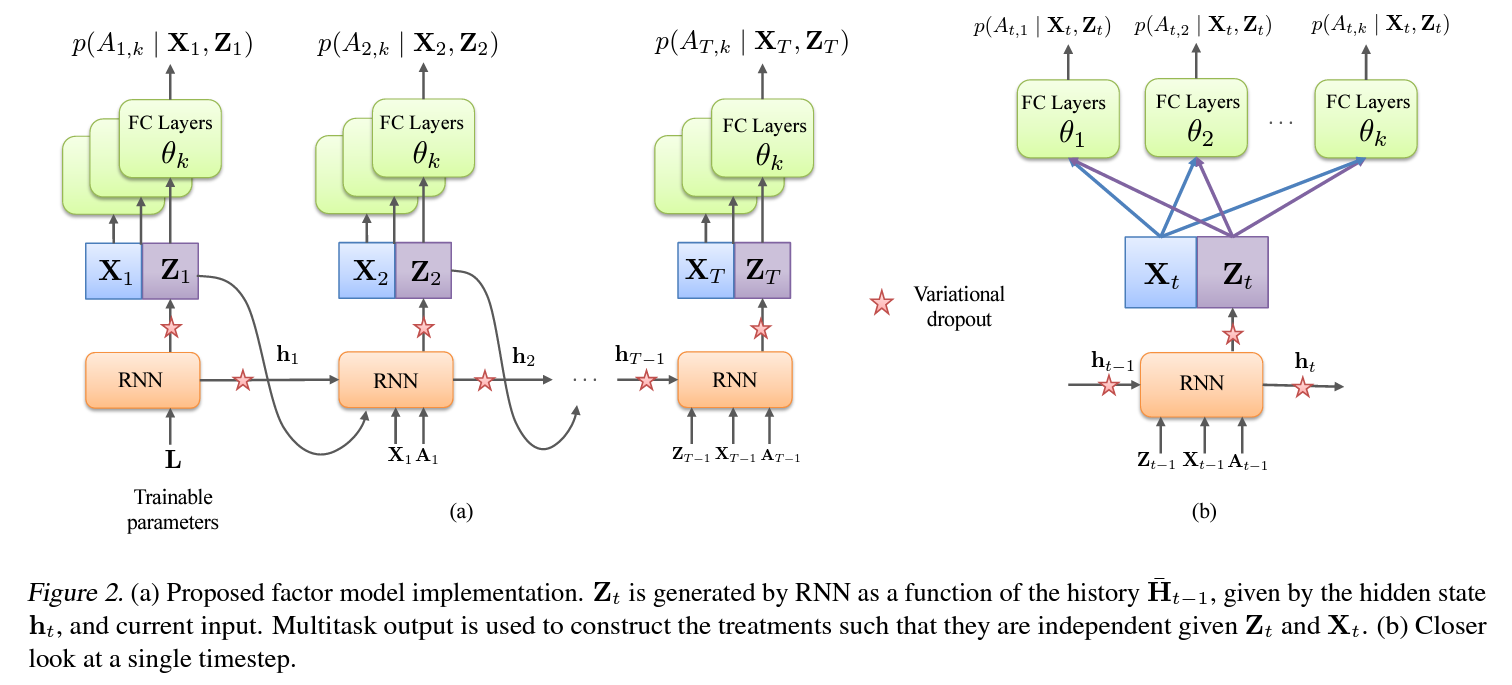

5. Factor Model over Time in Practice

$\mathbf{Z}_1=\mathrm{RNN}(\mathbf{L})$

$\mathbf{Z}_t=\mathrm{RNN}(\overline{\mathbf{Z}}_{t-1},\overline{\mathbf{X}}_{t-1},\overline{\mathbf{A}}_{t-1},\mathbf{L})$

$A_{tj}=\mathrm{FC}(\mathbf{X}_t, \mathbf{Z}_t;\theta_j)$

6. Experiments on Synthetic Data

6.1. Simulated Dataset

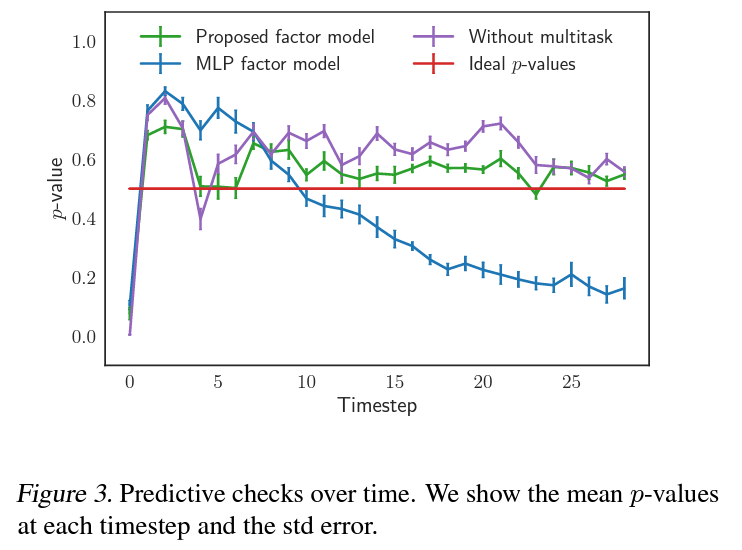

6.2. Evaluating Factor Model using Predictive Checks

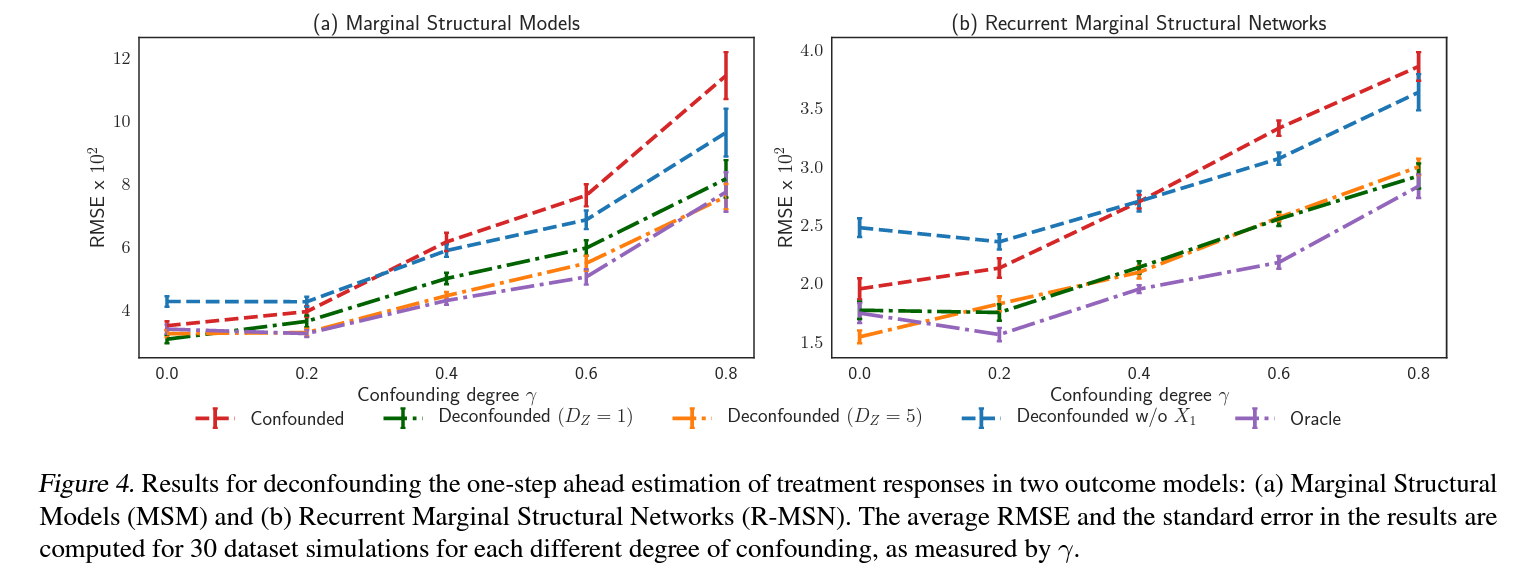

6.3. Deconfounding the Estimation of Treatment Responses over Time

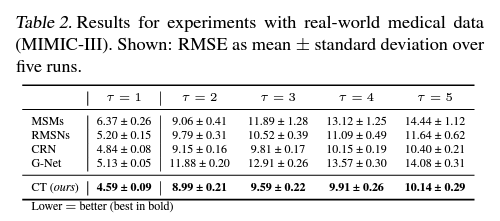

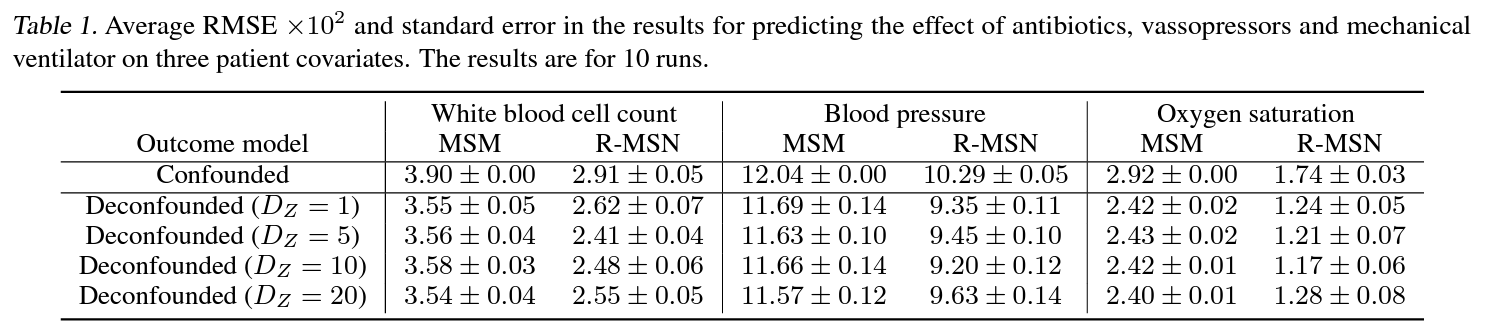

7. Experiments on MIMIC III

8. Conclusion

9. Appendix

Author: Ioana Bica, Daniel Jarrett, Alihan Hüyük, Mihaela van der Schaar

Paper Link: https://openreview.net/forum?id=h0de3QWtGG

Talk in ICLR2021: https://iclr.cc/virtual_2020/poster_BJg866NFvB.html

Rating: 8, 7, 6, 5

Author : Yaobin Ling, Pulakesh Upadhyaya, Luyao Chen, Xiaoqian Jiang, Yejin Kim

Paper Link : https://arxiv.org/abs/2109.12769

박지용 교수님께서 기획하신 2021년 인과추론 써머세션에서 김예진 교수님께서 강의해주신 Heterogenous Treatment Effect Estimation using ML 세션을 정말 재밌게 들었는데, 이에 대한 튜토리얼 및 벤치마크 논문이 워킹페이퍼로 공개되었다. 논문을 보면 필요한 용어에 대해 상세히 정의해두었고 특히 예시를 정말 잘 활용하고 있어서 처음 causal inference를 접하는 사람들에게 너무 좋은 내용이다.

아래는 줌으로 실강을 듣고나서도 여러번 반복해서 더 들은 김예진 교수님의 강의. 이런 좋은 강의를 한국어로 들을 수 있다니 두 교수님께 감사하다.

Author : Andrew Forney, Elias Bareinboim

Paper Link : https://ojs.aaai.org//index.php/AAAI/article/view/4090

Author : Ioana Bica, Ahmed M Alaa, James Jordon, Mihaela van der Schaar

Paper Link : https://openreview.net/forum?id=BJg866NFvB

Talk in ICLR2020: https://iclr.cc/virtual_2020/poster_BJg866NFvB.html

Rating: 8, 6, 6

Author : Anonymous (Naver Labs Europe이지 않을까)

Paper Link : https://openreview.net/forum?id=1L0C5ROtFp

Rating: 5, 6, 10

Author : Anonymous authors

Paper Link : https://openreview.net/forum?id=uy602F8cTrh

Author : Amir Feder, Katherine A. Keith, Emaad Manzoor, Reid Pryzant, Dhanya Sridhar, Zach Wood-Doughty, Jacob Eisenstein, Justin Grimmer, Roi Reichart, Margaret E. Roberts, Brandon M. Stewart, Victor Veitch, Diyi Yang

Paper Link : https://arxiv.org/abs/2109.00725

Related Repository: https://github.com/causaltext/causal-text-papers